生成AIが押し上げる攻撃の再現性

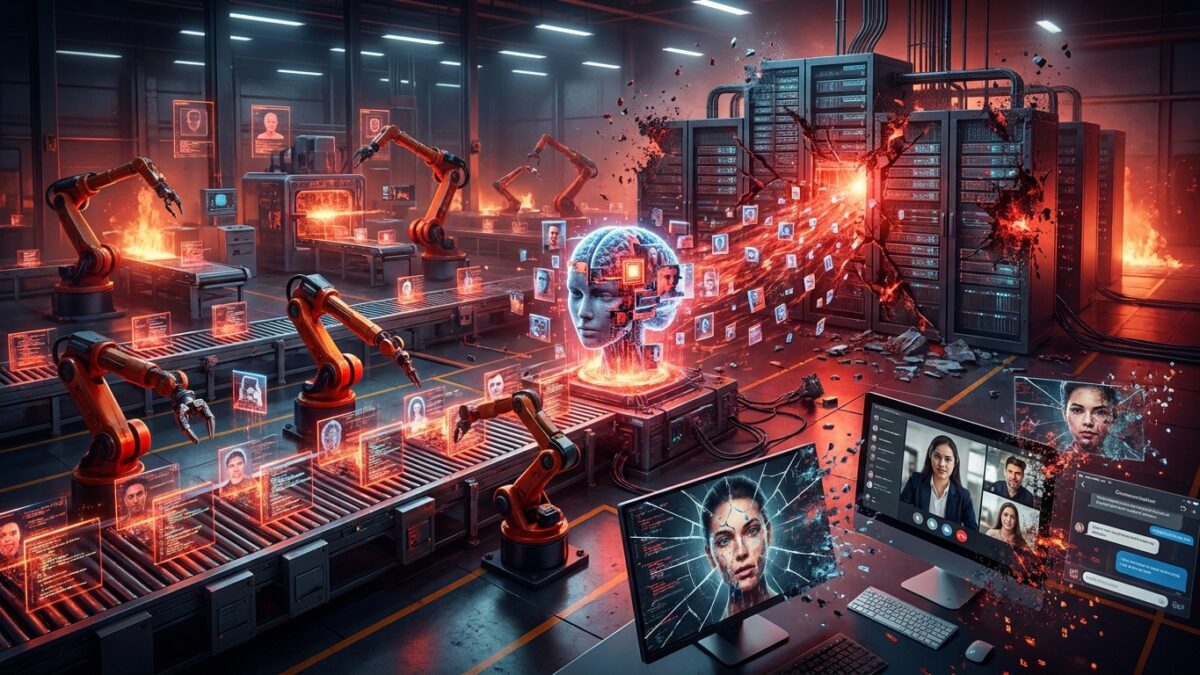

生成AIの普及で、攻撃は「熟練者の手作業」から「誰でも回せる反復作業」へ移行している。自然な日本語のフィッシングやBECが大量生産され、標的ごとのパーソナライズも容易だ。加えて公開情報や断片的なログからアタックサーフェスを推定し、70点の手口を高速に試行する運用が現実化する。

さらに音声合成やディープフェイクにより、電話や会議での本人確認が崩れる。「人が聞けば分かる」「映像があるから安全」という思い込みが攻撃面になる。情シスは認証要素の強化だけでなく、業務プロセス自体の見直しを前提に置くべきである。

防御側AIの限界と新たな運用リスク

防御でもAIは有効だが、万能の盾ではない。設計が弱いと誤検知が増え、アラート疲れで重要事象を見落とす。逆に未知の攻撃や環境変化で見逃しても、判断根拠を説明できず是正が遅れる。

社内AI活用ではプロンプトインジェクションや、社員による機密投入による漏えいが現実的な脅威となる。外部AIのログ保持や学習への混入も含め、データ取り扱いと監査の設計が欠かせない。

「ミュトス型」危険性の中身

危険性の本質は性能向上そのものではなく、低コスト化で裾野が広がり、高速化で被害が短時間に拡大し、自律化で検知・封じ込めが難しくなる点にある。巧妙化よりも「同時多発で速い」ことが組織防御の前提を変える。従来の人手中心の対応速度では追いつかない状況を想定した設計が必要だ。

情シスが優先すべき現実的対策

まず送金・承認フローのAI耐性を上げる。口座変更や緊急送金はメール完結を禁止し、別経路コールバックを必須化する。音声合成を前提に、合言葉だけでなく契約番号や発注条件など社内でしか共有されない取引文脈で相互確認する。

次にゼロトラストを運用に落とす。MFA、端末健全性、最小権限、セグメンテーション、特権IDの分離をSaaS/クラウド/社内横断で徹底する。あわせて認証・権限変更・データ持ち出し等の重要ログを統一収集し、検知から封じ込めまでの手順と責任分界を平時に演習で固める。

最後にAI利用ルールと技術的抑止をセットで整備する。入力禁止情報を機密区分で明確化し、DLPやCASBで外部AIへの投入を制御する。委託先・子会社も含め、外部AI利用や学習データ管理、生成物レビュー体制を質問票・契約条項に反映し、サプライチェーン全体で水準を揃えることが重要である。